Dalam era digital yang berkembang pesat, data telah menjadi komoditas berharga yang membentuk fondasi bisnis dan pengambilan keputusan. Salah satu metode utama untuk mengumpulkan data dari internet adalah melalui crawling data.

Artikel ini akan membahas secara mendalam tentang konsep crawling data, termasuk definisinya, perbedaannya dengan web scraping, prosesnya, serta dampaknya pada berbagai industri.

Daftar Isi

ToggleApa itu Crawling Data?

Crawling data merupakan sebuah proses yang vital dalam dunia internet, yang memungkinkan pengumpulan data secara otomatis dari berbagai sumber di internet. Ini adalah teknik penting yang digunakan oleh mesin pencari seperti Google untuk mengindeks dan memahami konten yang ada di web. Dalam konteks ini, mari kita telaah definisi crawling data dan perbedaannya dengan web scraping.

Definisi Crawling Data

Crawling data, juga dikenal sebagai web crawling atau spidering, adalah suatu proses yang dilakukan oleh program komputer yang disebut crawler atau bot. Tujuan dari crawling data adalah untuk menjelajahi internet, mengindeks halaman-halaman web, dan mengumpulkan informasi yang dapat digunakan oleh mesin pencari atau aplikasi lainnya.

Proses crawling data dimulai dengan crawler mengunjungi sebuah halaman web tertentu. Selanjutnya, crawler ini akan mengikuti tautan-tautan yang ada di halaman tersebut, dan begitu seterusnya.

Informasi yang ditemukan di setiap halaman akan diambil, dilakukan indeks, dan disimpan dalam basis data. Dengan cara ini, mesin pencari dapat memberikan hasil pencarian yang akurat dan relevan saat pengguna mencari informasi di internet.

Perbedaan antara Crawling Data dan Web Scraping

Walaupun seringkali disamakan, crawling data dan web scraping memiliki perbedaan yang penting. Mari kita bahas perbedaan utama antara keduanya:

a. Ruang Lingkup Pengambilan Data

- Pada crawling data, proses ini mencakup pengumpulan data dalam skala besar dari berbagai sumber dan halaman web yang berbeda. Crawling data lebih berfokus pada indeks dan pengumpulan data yang luas dan terstruktur.

- Sementara web scraping lebih terfokus pada pengambilan data dari halaman web tertentu. Web scraping umumnya digunakan untuk mengambil informasi yang lebih spesifik, seperti harga produk dari halaman e-commerce atau artikel dari situs berita.

b. Otomatisasi

- Crawling data dilakukan secara otomatis oleh crawler atau bot yang mengikuti tautan-tautan di web. Proses ini biasanya bersifat terus-menerus dan berkelanjutan untuk menjaga informasi tetap mutakhir.

- Sementara itu, meskipun dapat diotomatisasi, web scraping seringkali memerlukan pemrograman yang lebih khusus dan detail tergantung pada struktur halaman web yang akan dilakukan scrape.

c. Tujuan

- Crawling data memiliki tujuan untuk mengindeks dan menjelajahi seluruh web, memahami struktur situs, dan mengumpulkan data yang relevan untuk digunakan dalam hasil pencarian dan indeks mesin pencari.

- Web scraping digunakan untuk mengambil data tertentu dari sebuah situs web sesuai dengan kebutuhan tertentu, seperti pengumpulan harga produk, ulasan, atau informasi kontak.

Proses Crawling Data

Proses crawling data adalah tahapan penting dalam pengumpulan dan indeksasi informasi di internet. Dalam tahapan ini, crawler atau bot menjelajahi halaman web, mengumpulkan data, dan mengindeksnya. Untuk memahami proses ini lebih dalam, mari kita bahas bagaimana mesin pencari melakukan crawling data dan algoritma yang digunakan dalam proses ini.

Bagaimana Mesin Pencari Melakukan Crawling Data?

Di bawah ini adalah cara-cara yang dilakukan oleh mesin pencari untuk melakukan crawling data, antara lain:

- Memulai dari titik awal: Proses crawling data dimulai dari satu atau beberapa titik awal, yang bisa berupa halaman web tertentu atau sekelompok URL yang telah ditentukan sebelumnya. Crawler akan mengunjungi salah satu dari titik ini.

- Mengikuti tautan: Setelah mengunjungi halaman awal, crawler akan mulai mengikuti tautan-tautan yang ada di halaman tersebut. Ini dilakukan secara terus-menerus hingga crawler menjelajahi banyak halaman web.

- Mengindeks informasi: Selama menjelajah, crawler akan mengambil data dari setiap halaman web yang dikunjungi. Data ini meliputi teks, gambar, tautan, meta deskripsi, judul, dan elemen-elemen lain yang relevan. Informasi ini kemudian akan dilakukan indeks dalam basis data.

- Memutakhirkan data: Crawler biasanya akan mengunjungi halaman-halaman web yang telah diindeks sebelumnya secara berkala untuk memastikan bahwa data yang disimpan tetap mutakhir. Hal ini penting untuk memberikan hasil pencarian yang akurat.

- Mengelola politeness: Crawler juga memperhatikan etika dalam pengambilan data. Misalnya, mereka dapat mematuhi file robots.txt yang terdapat pada host situs web untuk menentukan halaman mana yang boleh atau tidak boleh diindeks.

Baca Juga: Jenis-Jenis dan Cara Membangun Backlink Berkualitas dalam SEO

Algoritma yang Digunakan dalam Crawling Data

Dalam rangka menjalankan proses crawling data dengan efisien, mesin pencari menggunakan berbagai algoritma yang canggih. Beberapa algoritma kunci dalam proses ini termasuk:

- Algoritma antrian (queue algorithm): Algoritma ini menentukan urutan halaman mana yang akan diambil oleh crawler. Biasanya, halaman-halaman yang lebih penting atau populer akan diindeks terlebih dahulu. Ini memastikan bahwa hasil pencarian relevan dapat diberikan kepada pengguna lebih cepat.

- Algoritma prioritas (priority algorithm): Algoritma ini mengatur prioritas halaman yang diindeks berdasarkan sejumlah faktor, seperti pentingnya halaman tersebut atau seberapa sering halaman itu diperbarui. Halaman-halaman yang dianggap lebih penting akan dilakukan indeks lebih cepat.

- Algoritma deduplikasi (deduplication algorithm): Algoritma ini bertugas untuk menghindari indeks data ganda. Saat crawler menemukan halaman yang sama di beberapa sumber, algoritma deduplikasi akan memastikan bahwa hanya satu salinan data tersebut yang diindeks.

- Algoritma politeness (politeness algorithm): Algoritma ini memastikan bahwa crawler berperilaku dengan baik saat mengunjungi halaman web. Mereka mengikuti aturan-aturan seperti waktu antara kunjungan ke halaman yang sama, dan menghindari mengakses halaman-halaman yang tidak diinginkan.

Contoh Penggunaan Data Crawling dalam Berbagai Industri

Data crawling sangat berpengaruh besar terhadap digitalisasi industri, termasuk di antaranya e-commerce, perbankan, dan hiburan atau entertainment. Di bawah ini Anda akan melihat beberapa contoh penggunaan data crawling dalam beberapa industri, antara lain:

1. Industri e-Commerce

Industri e-commerce sangat bergantung pada crawling data. Perusahaan e-commerce menggunakan crawling data untuk berbagai tujuan, termasuk:

- Pemantauan harga pesaing: e-Commerce dapat mengikuti harga pesaing secara real-time dan menyesuaikan harga untuk tetap kompetitif.

- Pemantauan persediaan: Perusahaan dapat memantau persediaan produk untuk menghindari kekurangan atau kelebihan persediaan.

- Analisis ulasan produk: Crawling data juga digunakan untuk mengumpulkan dan menganalisis ulasan produk untuk mendapatkan wawasan konsumen.

2. Industri Perbankan

Dalam industri perbankan, crawling data digunakan untuk:

- Pemantauan berita keuangan: Bank menggunakan crawling data untuk mengumpulkan berita ekonomi dan keuangan secara real-time, sehingga dapat merespons perubahan pasar dengan cepat.

- Pemantauan investasi: Data pasar dan trend investasi yang diambil melalui crawling data membantu bank dalam pengambilan keputusan investasi yang lebih baik.

- Analisis risiko kredit: Bank dapat menggunakan data yang diperoleh melalui crawling data untuk mengevaluasi risiko kredit.

Baca Juga: 5 Cara Kerja Web Crawler dalam SEO

3. Industri Entertainment

Industri hiburan menggunakan crawling data untuk:

- Pemantauan sentimen penggemar: Perusahaan hiburan mengumpulkan data dari media sosial dan platform online untuk mengukur sentimen penggemar terhadap acara atau artis tertentu.

- Pemantauan kinerja film: Crawling data digunakan untuk mengumpulkan data kinerja film, seperti penjualan tiket dan ulasan, yang membantu perusahaan hiburan dalam mengukur keberhasilan produksi.

- Pemantauan trend musik: Industri musik menggunakan crawling data untuk melacak trend musik dan mendukung keputusan strategis, seperti merilis lagu-lagu baru atau mengatur tur konser.

Dampak Data Crawling pada Bisnis dan Industri

Berikut ini adalah beberapa dampak data crawling pada bisnis dan industri, antara lain:

1. Meningkatkan Persaingan Bisnis

Menggunakan crawling data memberikan keunggulan kompetitif bagi perusahaan. Dengan akses yang lebih baik ke data pasar dan pesaing, perusahaan dapat menjadi lebih responsif terhadap perubahan dalam lingkungan bisnis.

Anda dapat mengembangkan produk dan layanan yang lebih sesuai dengan kebutuhan pelanggan dan menawarkan harga yang lebih kompetitif.

2. Meningkatkan Kualitas Produk dan Layanan

Data yang diperoleh melalui data crawling membantu perusahaan memahami kebutuhan pelanggan dengan lebih baik. Ini memungkinkan untuk meningkatkan kualitas produk dan layanan.

Perusahaan dapat merespons umpan balik pelanggan secara lebih baik dan menyempurnakan produk sesuai dengan harapan konsumen.

Baca Juga: Pengertian Web Crawling dan Penerapannya dalam SEO

3. Meningkatkan Efisiensi Operasional

Dalam bisnis, efisiensi operasional adalah kunci kesuksesan. Dengan akses yang lebih baik ke data, perusahaan dapat mengoptimalkan berbagai aspek operasional. Ini mencakup manajemen rantai pasokan yang lebih efisien, manajemen inventaris yang lebih baik, dan pemantauan kinerja staf dan proses operasional lainnya. Hal ini mengarah pada penghematan biaya dan peningkatan produktivitas.

Kesimpulan

Implikasi positif data crawling pada bisnis dan industri sangat signifikan. Ini dapat meningkatkan persaingan bisnis, meningkatkan kualitas produk dan layanan, serta meningkatkan efisiensi operasional. Dengan memahami dan memanfaatkan data crawling, perusahaan dapat mengambil keuntungan besar dalam era informasi digital ini.

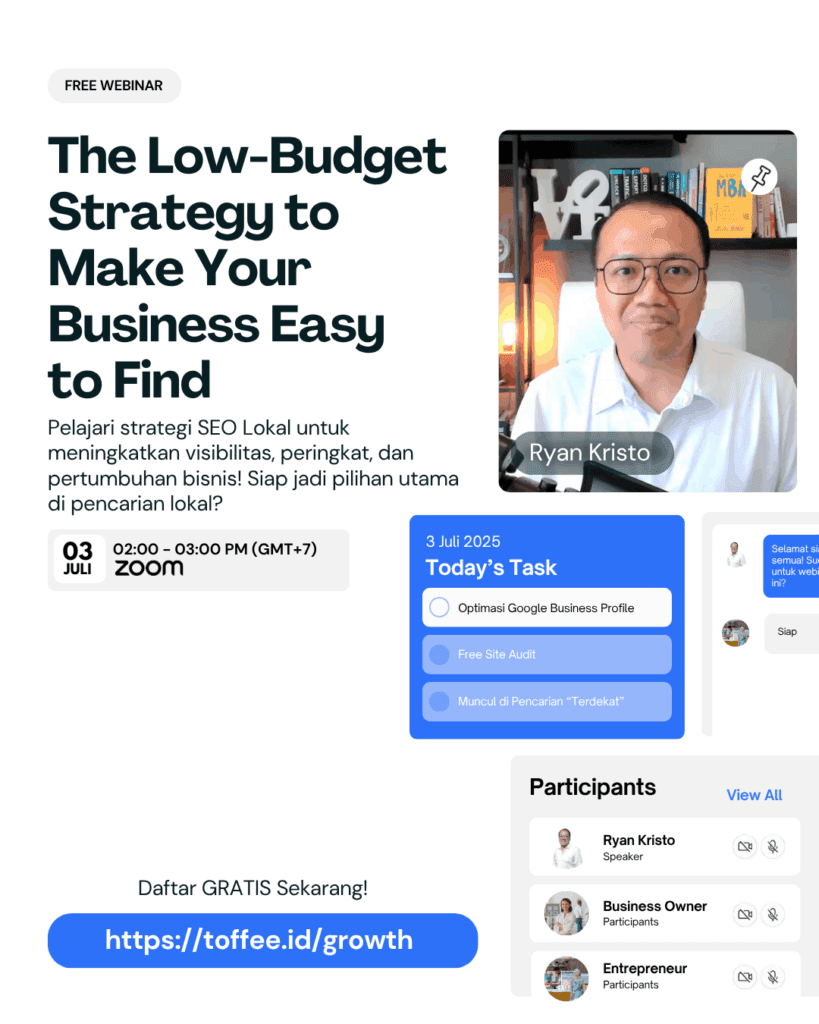

Selain memahami data crawling, penting bagi pemilik bisnis untuk memanfaatkan jasa dari Digital Marketing Agency seperti ToffeeDev. Dukungan profesional dalam mengoptimalkan visibilitas bisnis Anda di platform online memungkinkan Anda dapat meningkatkan efisiensi penggunaan website dan mencapai audiens yang lebih luas.

Jangan lewatkan peluang untuk memanfaatkan teknologi dan data dalam mendukung kesuksesan bisnis Anda. Jika Anda tertarik untuk bermitra bersama kami? Hubungi dan jadwalkan konsultasi dengan kami segera dan tingkatkan visibilitas dan konversi bisnis Anda bersama ToffeeDev!